技術文章

2021-08-03 AIGO計劃辦公室 4105

管理模型為企業導入AI後的重要挑戰

從人工智慧的興起至今已逐漸廣泛應用於各產業當中,企業在AI支出呈現翻倍成長,根據2019年4月The Wall Street

Journal報導顯示,企業在AI系統支出將從2019年的358億美元增長至2022年792億美元;研調顧問公司Mckinsey公開報告也提出,至2030年約有70%的公司會採用至少一項以上的人工智慧應用。雖然企業積極的在導入AI技術,但是對於機器學習的營運也面臨了重大挑戰。現今導入AI企業開始意識到,訓練模型和部署AI只是第一步驟,其後的管理模型、如何確保模型的可靠度(譬如模型數據是否產生飄移抑或模型是否因時間而衰退)以及確保模型無風險(有沒有偏見或歧視),並且模型可以隨著時間推移,這些都是導入AI後的重要營運挑戰。

美國新創公司Fiddler AI提供可解釋的AI模型監控平台,該解決方案將監控與可解釋性整合在一起,可以不間斷的監控模型性能,以保持模型的可靠度和驗證有無偏見,讓模型能夠依循法遵,解決廣泛的機器學習營運問題,從而節省團隊的時間和金錢成本。

資料來源:MIC,2021年7月 圖1 現今機器學習面臨的課題

Fiddler透過可解釋AI建立模型可信任與可理解

Fiddler成立於2018年,總部位於美國加州,創立宗旨為幫助企業都能夠解讀AI黑盒子,並為其客戶提供可信賴的AI體驗。Fiddler開發可解釋AI引擎,提供企業簡易的操作介面,理解機器學型模型,包含AI預測準則、分析AI決策行為以及管理AI,使AI符合規範並監控AI性能表現。透過可解釋AI平台讓企業組織、主管人員或資料科學家,均可透過簡易的操作介面,進行大規模地分析管理與部署機器學習模型,建立可信任且可理解的AI解決方案。2020年開始Fiddler獲得零售龍頭Amazon Alexa Fund的戰略性投資,Fiddler和Alexa基金會將合作推進AI的可解釋性,使企業對使用的AI系統具有完整而連續的可見性,以確保高性能、負責任和透明的AI解決方案。截至今Fiddler獲得的總募資金額為4,520萬美元,主要投資人為Amazon

Alexa Fund、Bloomberg Beta與Lux Capital。

在傑出肯定上,2019年10月被選為「Gartner企業AI治理與道德回應的優秀供應商」。2020年入選2020 CB Insights Game changer,CB Insights將其列為透明可解釋性AI平台遊戲顛覆者,同年也獲得世界經濟論壇的選為科技先鋒的肯定,並於2021年入選CB Insights AI 100。Fiddler在2018到2020年間發表了多篇有關如何構建可以解釋的AI模型的研究論文,目前其AI平台已進入概念性驗證階段並且正在使用該研究中論述的方法來構建其產品。

整合可解釋性與監控反饋迴路,保持模型公平無偏見

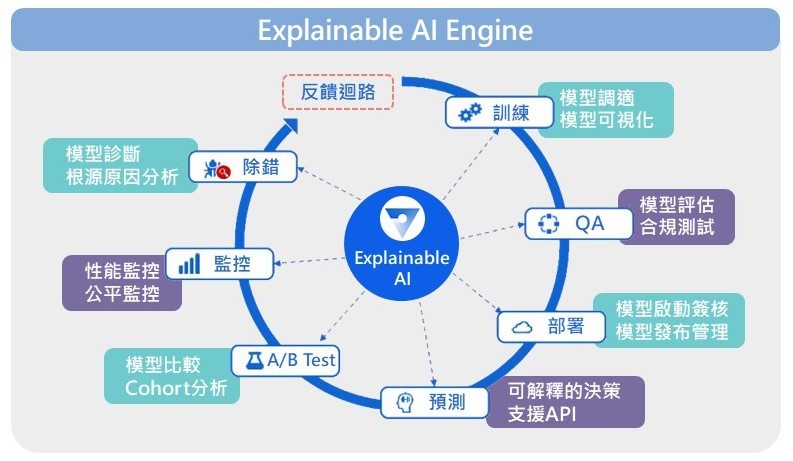

Fiddler的核心產品「Explainable AI Engine」為可解釋性的AI監管平台。現今深度神經網路中面臨的問題在於黑盒子它輸出的決策難以被解釋,它可能會造成不同行業及不同人員的困擾,例如企業主或投資決策者是否可以信任AI決策;金融業中的客服人員如何向客戶解釋AI的投資或審核決策;醫療組織中醫生如何告知病患AI對於診斷的見解。除了難以解釋的問題,黑盒子同樣面臨難以監管的挑戰,例如系統維運人員如何監控AI模型或除錯(debug);資料科學家如何得知模型以達到最佳化;再者,監管或審查機關如何確認AI模型是合乎法遵或無偏見的。

Explainable AI Engine透過以下三種方式來解決客戶的問題,(一)了解AI決策原因:可解釋AI引擎能從任何平台導入數據和模型,以在Fiddler中進行解釋,還可以運用平台快速產出可視化圖表,並通用於團隊的電子郵件、雲端,兼容各種格式。由於是可解釋的AI決策,可以人為監控平台確保遵守法規。(二)分析AI行為:分析AI模型所做的每一次預測,驗證模型對每次輸入是否產生結果。此外可以比較訓練數據,測試數據和生產數據之間的分佈,也可以將數據分成幾組,並解釋各組之間的性能差異;(三)監控AI的性能:Fiddler

AI引擎會監控模型的狀況使其保持高性能,也能追蹤異常值並發出警報,讓客戶能快速修復並重新訓練模型,警報可以使用平台New

Alert的功能來有效的監控各種問題的詳細訊息和解決方法。

資料來源:MIC,2021年7月 圖2 Explainable AI Engine運作模式

建立可信任的AI與持續監管模型為企業重要課題

2018年5月25日歐盟正式實施了「一般資料保護規定」(General Data Protection Regulation, GDPR)號稱史上最嚴格個資保護法;2020年美國「加州消費者隱私保護法」(California Consumer Privacy Act, CCPA)也開始實施。GDPR其中第22條規定,歐洲人有權利得知對其生活中產生重大影響的自動化決策。歐盟GDPR與美國CCPA法遵皆要求AI涉及使用個人資料時需要具備隱私性(Privacy)、公平性(Fairness)、透明性(Transparency)以及可解釋性(Explainability)。

Fiddler Labs的可解釋的AI引擎幫助企業大規模分析、管理和部署機器學習模型,提供簡單操作介面,從企業的資料科學家到高層主管,任何人都可以了解他們的AI技術。在實際案例中,AI黑盒子的確造成企業面臨到是否可信任的質疑,像是根據路透社報導亞馬遜的 AI招募工具,在履歷篩選中有歧視女性的傾向;或是特斯拉的自駕功能車禍意外,也讓人們懷疑AI是否可以信任等。隨著各國日趨重視AI道德與治理等問題以及AI監管法規與倡議逐漸上路,企業如何打造可信任的AI並且持續監管模型視為企業在AI道路上的重要課題。

財團法人資訊工業策進會 產業情報研究所(MIC)

張皓甯 產業分析師